معرفی کلان داده (Big Data)

کلان داده (Big Data) زمینه ای است که به روش های تجزیه و تحلیل، استخراج منظم اطلاعات می پردازد و یا در غیر این صورت، مقابله با مجموعه داده هایی که بسیار بزرگ یا پیچیده هستند و توسط نرم افزار سنتی پردازش داده ها می پردازد، برخورد می کند. داده هایی که بسیاری از موارد (ردیف ها) قدرت آماری بیشتری را ارائه می دهند، در حالی که داده هایی با پیچیدگی بالاتر (ویژگی ها یا ستون های بیشتر) ممکن است منجر به میزان کشف اشتباه (FDR) شوند. چالش های کلان داده شامل ضبط داده ها، ذخیره سازی داده ها، تحلیل داده ها، جستجو، به اشتراک گذاری، انتقال، ویژوال سازی، پرس و جو، به روزرسانی، حفظ حریم خصوصی اطلاعات و منبع داده است. بیگ دیتا در ابتدا با سه مفهوم اصلی همراه بودند. هنگامی که از کلان داده استفاده می کنیم، ممکن است نمونه نگیریم، بلکه به سادگی مشاهده و پیگیری آنچه اتفاق می افتد را مشاهده می کنیم. بنابراین، کلان داده اغلب شامل داده هایی با اندازه هایی هستند که از ظرفیت نرم افزار سنتی برای پردازش در یک زمان و مقدار قابل قبول فراتر می روند.

استفاده فعلی از اصطلاح کلان داده تمایل به استفاده از تجزیه و تحلیل های پیش بینی کننده، آنالیز رفتار کاربر یا برخی دیگر از روش های پیشرفته دیگر تجزیه و تحلیل داده ها دارد که از داده ها ارزش می گیرند، و بندرت به اندازه خاصی از مجموعه داده ها اشاره دارد. شک کمی وجود دارد که مقادیر داده های موجود اکنون واقعاً زیاد هستند، اما این مهمترین ویژگی این اکوسیستم جدید داده نیست. تجزیه و تحلیل مجموعه داده ها می تواند ارتباطات جدیدی را با توجه به روند کسب و کار، جلوگیری از بیماری ها، مبارزه با جرم و غیره پیدا کند. دانشمندان، مدیران كسب و كار، پزشكان، تبلیغات و دولت ها به طور مرتب با مجموعه کلان داده در زمینه هایی از جمله جستجوی اینترنتی، فناوری پیشرفته، فناوری اطلاعات شهری و انفورماتیک كاری با مشكلات مواجه می شوند. دانشمندان با محدودیت هایی در کار علوم الکترونیکی، از جمله هواشناسی، ژنومیک، کانکوماتیک، شبیه سازی های پیچیده فیزیک، زیست شناسی و تحقیقات زیست محیطی روبرو می شوند.

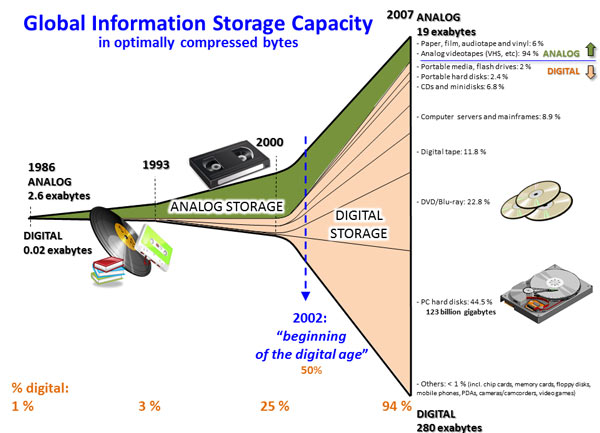

مجموعه داده ها به سرعت رشد می کند، به دلیل اینکه آن ها به طور فزاینده ای توسط دستگاه های اطلاعاتی ارزان قیمت و بی شماری از دستگاه هایی مانند دستگاه های تلفن همراه، هوایی (سنجش از راه دور)، لاگ های مربوط به نرم افزار، دوربین، میکروفون، شناسایی فرکانس رادیویی (RFID) جمع آوری می شوند. شبکه های حسگر بی سیم ظرفیت سرانه فناوری در جهان برای ذخیره اطلاعات تقریباً 40 ماه از دهه 1980 دو برابر شده است. از سال 2012، هر روز 2.5 اگزابایت (1018 2.5 2.5) داده تولید می شود. براساس پیش بینی گزارش IDC، حجم جهانی داده ها از سال 2013 تا 2020 از 4.4 Zettabytes به 44 Zettabytes رشد خواهد کرد. تا سال 2025، IDC پیش بینی می کند 163 Zettabytes داده وجود داشته باشد. یک سوال برای بنگاه های بزرگ تعیین این است که چه کسی باید ابتکار عمل کلان داده داشته باشد که بر کل سازمان تأثیر بگذارد.

سیستم های مدیریت پایگاه داده های عقلانی، آمار دسکتاپ و بسته های نرم افزاری که برای ویژوال سازی داده ها استفاده می شوند اغلب در پردازش کلان داده با مشکل روبرو هستند. این کار ممکن است به "نرم افزاری موازی با ده ها، صدها یا حتی هزاران سرور" نیاز داشته باشد. آنچه که به عنوان "کلان داده" شناخته می شود بسته به قابلیت های کاربران و ابزارهای آن ها متفاوت است و گسترش قابلیت ها باعث می شود کلان داده به یک هدف متحرک تبدیل شوند. برای بعضی از سازمان ها، برای اولین بار با صدها گیگابایت داده ممکن است نیاز به تجدید نظر در گزینه های مدیریت داده ها ایجاد کند. برای برخی دیگر، ممکن است ده ها یا صدها ترابایت طول بکشد تا اندازه داده ها مورد توجه واقع شود.

تعریف کلان داده (Big Data)

این اصطلاح از دهه 1990 میلادی مورد استفاده قرار می گیرد. کلان داده معمولاً شامل مجموعه داده هایی با اندازه های فراتر از توانایی ابزارهای نرم افزاری رایج برای ضبط، مدیریت، مدیریت و پردازش داده ها در مدت زمان قابل تحمل می شوند. فلسفه کلان داده شامل داده های بدون ساختار، نیمه ساختار یافته و ساختار یافته است، با این حال، تمرکز اصلی بر روی داده های بدون ساختار است. "اندازه" بزرگ از سال 2012 از چند ده ترابایت گرفته تا بسیاری از محتویات داده، یک هدف مداوم در حال حرکت است. کلان داده به افشای بینش از مجموعه داده های متنوع، پیچیده و در مقیاس گسترده نیازمند مجموعه ای از تکنیک ها و فناوری ها با اشکال جدید ادغام هستند.

تعریف سال 2018 "کلان داده در جایی است که برای پردازش داده ها به ابزارهای محاسباتی موازی نیاز دارند"، و خاطر نشان می کند، "این نشان دهنده یک تغییر مشخص و واضح تعریف شده در علم کامپیوتر مورد استفاده، از طریق تئوری های برنامه نویسی موازی، و ضرر برخی از قوانین و قابلیت های ساخته شده توسط مدل رابطه ای کد است. "

بلوغ فزاینده این مفهوم به طرز چشمگیری تفاوت بین "کلان داده" و "هوش تجاری" را مشخص می کند:

- هوش تجاری از ابزارهای ریاضی کاربردی و آمار توصیفی با داده هایی با چگالی اطلاعات بالا برای اندازه گیری موارد، تشخیص روندها و غیره استفاده می کند.

- کلان داده از تجزیه و تحلیل ریاضی، بهینه سازی، آمار استقرایی و مفاهیمی از شناسایی سیستم غیر خطی گرفته تا قوانین استنباطی (رگرسیون، روابط غیرخطی و تأثیرات علی) از مجموعه های بزرگی از داده ها با تراکم اطلاعات کم برای آشکار کردن روابط و وابستگی ها یا انجام پیش بینی های پیامدها و رفتارها استفاده می کنند.

ویژگی های کلان داده (Big Data)

کلان داده را می توان با ویژگی های زیر توصیف کرد:

ولوم

مقدار داده های تولید شده و ذخیره شده اندازه داده ها مقدار و بینش بالقوه را تعیین می کند و اینکه آیا می توان کلان دادهی در نظر گرفت یا خیر.

تنوع

نوع و ماهیت داده ها، این کمک می کند تا افرادی که آن را تجزیه و تحلیل می کنند به طور موثر از بینش حاصل استفاده کنند. کلان داده از متن، تصاویر، صدا، فیلم به دست می آید. بعلاوه قطعات گمشده را از طریق تلفیق داده ها تکمیل می کند.

سرعت

در این زمینه، سرعتی که در آن داده ها تولید و پردازش می شوند تا خواسته ها و چالش هایی را که در مسیر رشد و توسعه قرار دارد، برآورده سازیم. کلان داده اغلب در real-time در دسترس هستند. در مقایسه با داده های کوچک، کلان داده بطور مداوم تولید می شوند. دو نوع سرعت مربوط به کلان داده، فراوانی تولید و دفعات استفاده، ضبط و انتشار است.

صحت

این تعریف گسترده برای کلان داده است، که به کیفیت داده ها و مقدار داده اشاره دارد. کیفیت داده های ضبط شده می تواند تا حد زیادی متفاوت باشد و بر تجزیه و تحلیل دقیق تأثیر بگذارد. داده ها باید با ابزار پیشرفته (آنالیز و الگوریتم) پردازش شوند تا اطلاعات معنی دار را نشان دهند. به عنوان مثال، برای مدیریت یک کارخانه باید موضوعات مؤثر و نامرئی را با مؤلفه های مختلف در نظر بگیرید. الگوریتم های تولید اطلاعات باید موارد نامرئی مانند تخریب دستگاه، سایش اجزاء و غیره را در طبقه کارخانه ردیابی و بررسی کنند.

معماری کار با کلان داده (Big Data)

مخازن کلان داده به اشکال مختلف وجود دارند، که اغلب توسط شرکت هایی با نیاز ویژه ساخته می شوند. فروشندگان تجاری به طور تاریخی سیستم های مدیریت پایگاه داده موازی را برای شروع کلان داده در دهه 1990 ارائه می دادند. برای سال های طولانی، WinterCorp بزرگترین گزارش پایگاه داده را منتشر کرد.

شرکت Teradata در سال 1984 سیستم پردازش موازی سیستم DBC 1012 را به بازار عرضه کرد. سیستم های Teradata اولین کسی بودند که 1 ترابایت داده را در سال 1992 ذخیره و تجزیه و تحلیل کردند. درایو دیسک های سخت در سال 1991 2.5 گیگابایت بود بنابراین تعریف کلان داده به طور مداوم طبق قانون Kryder تکامل می یابد. Teradata اولین سیستم مبتنی بر کلاس petabyte RDBMS را در سال 2007 نصب کرد. از سال 2017، چند ده پایگاه داده ارتباطی Teradata کلاس petabyte نصب شده است که بزرگترین آن ها بیش از 50 PB است. سیستم های تا سال 2008 100٪ داده های رابطه ساختاری بودند. از آن زمان، Teradata انواع داده های غیرساختاری شامل XML ،JSON و Avro را اضافه کرده است.

در سال 2000، شركت Seisint يك پلتفرم توزيع شده مبتني بر ++C را براي پردازش داده ها و پرسيدن داده ها با نام HPCC Systems توسعه داده است. این سیستم به طور خودکار پارتیشن، توزیع، ذخیره و ذخیره داده های ساختاری، نیمه ساختار یافته و بدون ساختار در چندین سرور کالایی است. کاربران می توانند خط لوله ها و نمایش داده شدگان را با یک زبان برنامه نویسی اعلامیه داده به نام ECL بنویسند. تحلیلگران داده که در ECL کار می کنند، نیازی به تعریف طرح های داده به صورت مقدم ندارند و می توانند بر روی مسئله خاص موردنظر متمرکز شوند، و با ایجاد راه حل، داده ها را به بهترین وجه ممکن تغییر شکل دهند. در سال 2004، LexisNexis شرکت Seisint و پلت فرم پردازش موازی پر سرعت خود را به دست آورد و با موفقیت از این پلتفرم برای ادغام سیستم های داده از Choicepoint Inc در هنگام دستیابی به آن شرکت در سال 2008 استفاده کرد. در سال 2011، پلتفرم سیستم های HPCC بود.

CERN و سایر آزمایش های فیزیک مجموعه کلان داده را برای چندین دهه جمع آوری کرده اند، که معمولاً از طریق محاسبات با کارایی بالا (ابر رایانه ها) و نه معماری های کاهش نقشه کالا، مورد تجزیه و تحلیل قرار می گیرند که معمولاً با حرکت "کلان داده" انجام می شود.

در سال 2004، گوگل مقاله ای را درباره فرآیندی به نام MapReduce منتشر کرد که از یک معماری مشابه استفاده می کند. مفهوم MapReduce یک مدل پردازش موازی را ارائه می دهد، و یک پیوند مرتبط برای پردازش مقادیر عظیمی از داده ها منتشر شد. با MapReduce، نمایش داده شد و تقسیم می شود و در گره های موازی توزیع می شود و به صورت موازی پردازش می شوند (مرحله Map). سپس نتایج جمع آوری و تحویل داده می شوند (مرحله کاهش). این فریمورک بسیار موفق بود، بنابراین دیگران می خواستند الگوریتم را تکرار کنند. بنابراین، اجرای فریمورک MapReduce توسط یک پروژه منبع باز آپاچی به نام Hadoop به تصویب رسید. Apache Spark در پاسخ به محدودیت های موجود در الگوی MapReduce در سال 2012 توسعه داده شد، زیرا این امکان را برای تنظیم بسیاری از عملیات ها (نه تنها نقشه به دنبال آن کاهش) می دهد.

MIKE2.0 یک رویکرد آزاد برای مدیریت اطلاعات است که به دلیل پیامدهای کلان دادهی که در مقاله ای با عنوان "ارائه راه حل کلان داده" شناسایی شده است، نیاز به تجدید نظر را تأیید می کند. این متدولوژی رسیدگی به کلان داده را از نظر جایگاه های مفید منابع داده ها، پیچیدگی در روابط متقابل و مشکل در حذف (یا اصلاح) سوابق فردی به عهده دارد.

مطالعات سال 2012 نشان داد كه يك معماري چند لايه يكي از گزينه ها براي پرداختن به موضوعاتي است كه داده هاي بزرگ ارائه مي دهد. یک معماری موازی توزیع شده داده ها را در چندین سرور توزیع می کند. این محیط های اجرای موازی می توانند سرعت پردازش داده را به طرز چشمگیری بهبود بخشند. این نوع معماری داده ها را در DBMS موازی قرار می دهد، که استفاده از فریمورک های MapReduce و هدوپ را پیاده سازی می کند. به نظر می رسد این نوع فریمورک با استفاده از یک سرور برنامه فرانت اند قدرت پردازش را برای کاربر نهایی شفاف کند.

دریاچه داده به یک سازمان امکان می دهد تا تمرکز خود را از کنترل متمرکز به یک مدل مشترک تغییر دهد تا به پویایی در حال تغییر مدیریت اطلاعات پاسخ دهد. این امر تفکیک سریع داده ها را در دریاچه داده امکان پذیر می کند و در نتیجه زمان سربار را کاهش می دهد. تجزیه و تحلیل کلان داده برای تولید برنامه های کاربردی به عنوان "معماری 5C" (اتصال، تبدیل، سایبر، شناخت و پیکربندی) به بازار عرضه می شود. کارخانه و سیستم های فیزیکی سایبر ممکن است "سیستم 6C" گسترده ای داشته باشند:

- اتصال (سنسور و شبکه)

- ابر (محاسبه و داده به صورت تقاضا)

- سایبر (مدل و حافظه)

- محتوا / زمینه (معنی و همبستگی)

- جامعه (اشتراک و همکاری)

- شخصی سازی (شخصی سازی و ارزش)

تکنولوژی کلان داده (Big Data)

گزارش موسسه جهانی مک کینزی در سال 2011 مؤلفه های اصلی و اکوسیستم کلان داده را به شرح زیر توصیف می کند:

- تکنیک های تجزیه و تحلیل داده ها، مانند آزمایش A / B، یادگیری ماشین و پردازش زبان طبیعی

- فن آوری های کلان داده مانند هوش تجاری، رایانش ابری و پایگاه داده

- ویژوال سازی مانند نمودارها و نمایشگرهای دیگر داده ها

کلان داده چند بعدی همچنین می توانند به صورت مکعب داده یا از نظر ریاضی، سکانس نمایش داده شوند. سیستم های پایگاه داده Array در نظر گرفته اند که از این نوع داده پشتیبانی و پرس و جو سطح بالا را ارائه دهند. فن آوری های اضافی که برای کلان داده به کار می رود شامل محاسبات کارآمد مبتنی بر تانسور، مانند یادگیری زیرسطحی چند سطحی، پایگاه داده های پردازش موازی (MPP)، برنامه های مبتنی بر جستجو، داده کاوی، سیستم های توزیع فایل، حافظه پنهان توزیع شده (مانند بافر پشت سر هم و Memcached)، پایگاه داده های توزیع شده، زیرساخت های ابر و HPC (برنامه های کاربردی، ذخیره سازی و محاسبات) و اینترنت. اگرچه بسیاری از رویکردها و فن آوری ها توسعه یافته اند، اما انجام یادگیری ماشین با کلان داده هنوز دشوار است.

برخی از بانک های اطلاعاتی رابطه MPP توانایی ذخیره و مدیریت داده های petabytes را دارند. ضمنی توانایی دانلود، نظارت، تهیه نسخه پشتیبان و بهینه سازی استفاده از جداول کلان داده در RDBMS است. برنامه تحلیل توپولوژیک DARPA به دنبال ساختار بنیادی مجموعه های عظیم داده است و در سال 2008 این فناوری با راه اندازی شرکتی به نام ایاصدی به بازار آمد.

دست اندرکاران فرآیندهای تجزیه و تحلیل کلان داده عموماً خصمانه هستند تا ذخیره مشترک را کندتر کنند، و ترجیح می دهند ذخیره مستقیم متصل (DAS) را به اشکال مختلف از درایو حالت جامد (SSD) گرفته تا دیسک SATA با ظرفیت بالا در گره های پردازش موازی دفن کنند. برداشت از معماری های مشترک ذخیره سازی - شبکه منطقه ذخیره سازی (SAN) و ذخیره سازی متصل به شبکه (NAS) این است که نسبتاً کند، پیچیده و گران هستند. این خصوصیات با سیستم های بزرگ تجزیه و تحلیل داده ها که رونق عملکرد سیستم، زیرساخت کالاها و هزینه کم دارند، سازگار نیست.

تحویل اطلاعات در real-time یا نزدیک به واقعیت یکی از ویژگی های تعیین کننده تجزیه و تحلیل کلان داده است. از این رو از تأخیر در هر زمان و هر جا امکان پذیر است. داده های موجود در حافظه یا دیسک مستقیم مستقیم هستند. داده های موجود در حافظه یا دیسک در انتهای دیگر اتصال FC SAN نیست. هزینه یک SAN در مقیاس مورد نیاز برای برنامه های کاربردی تحلیلی بسیار بیشتر از سایر روشهای ذخیره سازی است.

کاربرد کلان داده (Big Data)

کلان داده تقاضا برای متخصصان مدیریت اطلاعات را به حدی افزایش داده است به گونه ای که نرم افزارهای AG، Oracle Corporation، IBM، Microsoft، SAP، EMC، HP و Dell بیش از 15 میلیارد دلار برای شرکت های نرم افزاری متخصص در مدیریت داده و تجزیه و تحلیل هزینه کرده اند. در سال 2010، این صنعت بیش از 100 میلیارد دلار ارزش داشت و تقریباً 10 درصد در سال در حال رشد بود: تقریباً دو برابر سریعتر از کل تجارت نرم افزار.

اقتصادهای توسعه یافته به طور فزاینده ای از فناوری های فشرده داده استفاده می کنند. در سراسر جهان 4.6 میلیارد اشتراک تلفن همراه وجود دارد و بین 1 تا 2 میلیارد نفر به اینترنت دسترسی دارند. بین سال های 1990 و 2005، بیش از 1 میلیارد نفر در سراسر جهان وارد طبقه متوسط شدند، این بدان معناست که بیشتر افراد با سواد تر شدند و این به نوبه خود منجر به رشد اطلاعات شد. ظرفیت موثر جهان برای تبادل اطلاعات از طریق شبکه های ارتباطی 281 پتابی در سال 1986، 471 پتابی در سال 1993، 2.2 اگزابایت در 2000، 65 اگزابایت در سال 2007 و پیش بینی ها میزان ترافیک اینترنت را سالانه 667 اگزابایت در سال 2014 عنوان کرده است. براساس یک تخمین، یک سوم اطلاعات ذخیره شده در سطح جهان به صورت متن الفبایی و داده های ثابت عکس است که فرمی است که برای اکثر برنامه های کاربردی داده بزرگ مفید است. این همچنین پتانسیل داده های بلا استفاده را نشان می دهد.

در حالی که بسیاری از فروشندگان راه حل های غیر قفسه ای را برای کلان داده ارائه می دهند، کارشناسان توصیه می کنند اگر شرکت از توانایی های فنی کافی برخوردار باشد، راه حل های داخلی را بصورت اختصاصی برای حل مشکل شرکت در نظر گرفته است.

دولت

استفاده و اتخاذ کلان داده در فرایندهای دولتی امکان کارآیی از نظر هزینه، بهره وری و نوآوری را فراهم می آورد، اما بدون نقص آن نتیجه نمی گیرد. تجزیه و تحلیل داده ها غالباً به چندین بخش دولتی (مرکزی و محلی) نیاز دارد تا با هم همکاری کنند و فرآیندهای جدید و خلاقانه ای را برای رسیدن به نتیجه مطلوب ایجاد کنند. CRVS (ثبت احوال و آمار حیاتی) کلیه وضعیت گواهینامه ها را از بدو تولد تا مرگ جمع آوری می کند. CRVS منبع اطلاعات بزرگی برای دولت ها است.

توسعه بین المللی

تحقیقات در مورد استفاده مؤثر از فناوری های اطلاعات و ارتباطات برای توسعه (همچنین به عنوان ICT4D شناخته می شود) نشان می دهد که فناوری کلان داده می توانند سهم مهمی داشته باشند اما همچنین چالش های بی نظیری را برای توسعه بین المللی به وجود می آورند. پیشرفت ها در تجزیه و تحلیل کلان داده، فرصت های مقرون به صرفه ای را برای بهبود تصمیم گیری در زمینه های مهم توسعه از جمله مراقبت های بهداشتی، اشتغال، بهره وری اقتصادی، جرم، امنیت، و بروز فاجعه طبیعی و مدیریت منابع فراهم می آورد. علاوه بر این، داده های ایجاد شده توسط کاربر فرصت های جدیدی را برای صدایی ناشناخته ارائه می دهند. با این حال، چالش های طولانی مدت برای توسعه مناطقی مانند زیرساخت های ناکافی فناوری و کمبود اقتصادی و منابع انسانی نگرانی های موجود را با کلان دادهی مانند حریم خصوصی، روش ناقص و مسائل مربوط به قابلیت همکاری تشدید می کند.

ساخت

بر اساس مطالعه روند جهانی جهانی TCS 2013، پیشرفت در برنامه ریزی عرضه و کیفیت محصول بیشترین مزیت کلان داده را برای تولید فراهم می کند. کلان داده زیرساختی برای شفافیت در صنعت تولید فراهم می کند، این امکان را برای برطرف کردن عدم قطعیت ها از جمله عملکرد متناسب با قطعه و در دسترس بودن فراهم می کند. پیش بینی تولید به عنوان یک رویکرد کاربردی در رابطه با خرابی نزدیک به صفر و شفافیت، نیاز به مقادیر گسترده ای از داده ها و ابزارهای پیش بینی پیشرفته برای یک فرآیند منظم داده ها به اطلاعات مفید دارد. یک فریمورک مفهومی از تولید پیش بینی با دستیابی به داده ها شروع می شود که در آن انواع مختلفی از داده های حسی برای دستیابی از قبیل صدا، لرزش، فشار، جریان، ولتاژ و کنترل کننده در دسترس است. حجم عظیمی از داده های حسی علاوه بر داده های تاریخی، کلان دادهی را در ساخت ایجاد می کنند. کلان داده تولید شده به عنوان ورودی ابزارهای پیش بینی کننده و راهکارهای پیشگیری مانند پیش آگهی و مدیریت بهداشت (PHM) عمل می کنند.

مراقبت های بهداشتی

تجزیه و تحلیل کلان داده با ارائه داروهای شخصی و تجزیه و تحلیل های تجربی، مداخله در معرض خطر بالینی و تجزیه و تحلیل پیش بینی، کاهش ضریب زباله و مراقبت، گزارش خودکار و خارجی و داخلی از داده های بیمار، اصطلاحات پزشکی استاندارد و ثبت های بیمار و راه حل های قطعه قطعه شده، به مراقبت های بهداشتی کمک کرده است. برخی از زمینه های بهبود، مشتاق تر از آنچه در واقع اجرا شده است. سطح داده های تولید شده در سیستم های مراقبت های بهداشتی بی اهمیت نیست. با اضافه شدن تصویب mHealth، eHealth و فناوری های پوشیدنی، حجم داده ها همچنان افزایش می یابد. این شامل داده های پرونده الکترونیکی سلامت، داده های تصویربرداری، داده های بیمار، داده های حسگر و سایر اشکال پردازش داده ها دشوار است. اکنون حتی نیاز به چنین محیط هایی برای توجه بیشتر به کیفیت داده ها و کیفیت اطلاعات نیز وجود دارد. "کلان داده اغلب به معنی" داده های کثیف "هستند و کسری از عدم صحت داده ها با رشد حجم داده ها افزایش می یابد." بازرسی انسانی در مقیاس کلان داده غیرممکن است و نیاز به خدمات درمانی به ابزارهای هوشمند برای صحت و کنترل باورپذیری و دست زدن به اطلاعات از دست رفته نیاز به خدمات بهداشتی دارد. در حالی که اکنون اطلاعات گسترده در مراقبت های بهداشتی الکترونیکی است، اما زیر چتر کلان داده قرار دارد زیرا بیشتر آن ها بدون ساختار و استفاده از آن ها دشوار است. استفاده از کلان داده در مراقبت های بهداشتی چالش های اخلاقی قابل توجهی را شامل می شود، از خطرات مربوط به حقوق فردی، حفظ حریم خصوصی و استقلال، تا شفافیت و اعتماد.

یک زیر برنامه کاربردی مرتبط، که به شدت به کلان داده متکی است، در حوزه مراقبت های بهداشتی، تشخیص پزشکی به کمک رایانه است. فقط لازم به یادآوری است که، برای مثال، برای نظارت بر صرع، مرسوم است که روزانه 5 تا 10 گیگابایت داده ایجاد کنید. به طور مشابه، یک تصویر بدون فشرده از توموسنتز پستان به طور متوسط 450 مگابایت داده است. این ها فقط تعداد معدودی از مثال های زیادی است که در آن از طریق کمک به رایانه، از کلان داده استفاده می شود. به همین دلیل، کلان داده به عنوان یکی از هفت چالش کلیدی که سیستم های تشخیصی به کمک رایانه باید برای غلبه بر آن دست یابند، برای رسیدن به سطح بعدی عملکرد شناخته شده است.

تحصیلات

یک مطالعه مؤسسه جهانی مک کینزی نشان داد که کمبود 1.5 میلیون متخصص و متخصص در داده ها بسیار آموزش دیده و تعدادی از دانشگاه ها از جمله دانشگاه تنسی و UC برکلی، برنامه های کارشناسی ارشد برای برآوردن این تقاضا ایجاد کرده اند. بوت کمپ خصوصی نیز برای برآوردن آن تقاضا برنامه هایی را تدوین کرده اند، از جمله برنامه های رایگان مانند داده انکوباتور یا برنامه های پولی مانند مجمع عمومی. در زمینه خاص بازاریابی، یکی از مشکلاتی که توسط Wedel و Kannan تأکید شده است این است که بازاریابی چندین زیر دامنه (به عنوان مثال، تبلیغات، تبلیغات، توسعه محصول، برندسازی) دارد که همه از انواع مختلف داده استفاده می کنند. از آنجا که همه راه حل های تحلیلی یک اندازه مناسب نیست، مدارس بازرگانی باید مدیران بازاریابی را آماده کنند تا دانش گسترده ای در مورد تمام تکنیک های مختلف بکار رفته در این زیر دامنه ها داشته باشند تا تصویر بزرگی بدست آورند و به طور موثر با تحلیلگران کار کنند.

رسانه ها

برای درک چگونگی استفاده رسانه از کلان داده، ابتدا لازم است زمینه ای برای مکانیسم مورد استفاده برای فرآیند رسانه فراهم شود. توسط نیک کالدری و جوزف تورو پیشنهاد شده است که متخصصان رسانه و تبلیغات به کلان داده به بسیاری از نقاط اکشن اطلاعات در مورد میلیون ها نفر نزدیک می شوند. به نظر می رسد این صنعت از رویکرد سنتی استفاده از محیط های رسانه ای خاص مانند روزنامه ها، مجلات یا برنامه های تلویزیونی فاصله می گیرد و در عوض با فناوری هایی که در مواقع بهینه در مکان های مطلوب به افراد هدفمند می رسد، به سمت مصرف کنندگان می رود. هدف نهایی ارائه یا انتقال، پیام یا محتوا متناسب با ذهنیت مصرف کننده است. به عنوان مثال، انتشار محیط به طور فزاینده ای متناسب با پیام ها (تبلیغات) و محتوا (مقالات) برای جلب توجه مشتریانی که به طور انحصاری از طریق فعالیت های مختلف داده کاوی جمع آوری شده اند، جذابیت دارد.

- هدف گذاری مصرف کنندگان (برای تبلیغات توسط بازاریابان)

- ضبط داده ها

- روزنامه نگاری داده: ناشران و روزنامه نگاران برای ارائه بینش و اینفوگرافیک های منحصر به فرد و ابتکاری از ابزارهای داده بزرگ استفاده می کنند.

بیمه

ارائه دهندگان بیمه خدمات درمانی در حال جمع آوری داده هایی در مورد "عوامل تعیین کننده سلامتی" اجتماعی مانند مصرف مواد غذایی و تلویزیون، وضعیت تأهل، اندازه لباس و عادات خرید هستند که از این طریق آن ها پیش بینی هایی درمورد هزینه های بهداشتی انجام می دهند تا در این زمینه مشکلات بهداشتی در مراجعان مشاهده شود. بحث برانگیز است که آیا این پیش بینی ها در حال حاضر برای قیمت گذاری استفاده می شود یا خیر.

اینترنت اشیاء (IoT)

کلان داده و IoT با هم کار می کنند. داده های استخراج شده از دستگاه های IoT نقشه برداری از اتصال دستگاه را فراهم می کند. این نقشه ها توسط صنعت رسانه، شرکت ها و دولت ها مورد استفاده قرار گرفته است تا مخاطبان خود را دقیق تر هدفمند کرده و کارایی رسانه ها را افزایش دهند. IoT همچنین به طور فزاینده ای به عنوان ابزاری برای جمع آوری داده های حسی تصویب می شود و از این داده های حسی در زمینه های پزشکی، ساخت و حمل و نقل استفاده شده است.

کوین اشتون، متخصص نوآوری دیجیتالی که اعتبار آن را با اختراع این اصطلاح در اختیار دارد، اینترنت اشیا را در این نقل قول تعریف می کند: "اگر ما رایانه هایی داشتیم که همه چیز را می دانستند، باید درباره چیزها بدانیم - با استفاده از داده هایی که آن ها بدون هیچ گونه کمکی از ما جمع می کردند". قادر به ردیابی و شمارش همه چیز، و ضایعات، تلفات و هزینه های زیادی را کاهش دهید. ما می دانیم که چه چیزهایی نیاز به تعویض، ترمیم یا فراخوانی دارد، و آیا تازه یا بهتر از گذشته هستند. "

فناوری اطلاعات

به خصوص از سال 2015، کلان داده در عملیات تجاری به عنوان ابزاری برای کمک به کارمندان کار می کنند تا کارآمدتر و ساده تر جمع آوری و توزیع فناوری اطلاعات (IT) باشند. استفاده از کلان داده برای حل و فصل مسائل مربوط به جمع آوری اطلاعات و اطلاعات در یک شرکت، آنالیز عملیات IT (ITOA) نام دارد. با استفاده از اصول کلان داده در مفاهیم هوش دستگاهی و محاسبات عمیق، بخش های فناوری اطلاعات می توانند مسائل احتمالی را پیش بینی کرده و قبل از بروز مشکلات حتی به ارائه راه حل بپردازند. در این زمان، مشاغل ITOA نیز با ارائه سیستم عامل هایی که سیلوهای داده های فردی را با هم جمع می کردند و به جای اینکه از جیب های جداشده از داده ها جمع شوند، نقش اصلی را در مدیریت سیستم ها بازی می کردند.

نرم افزار های کلان داده (Big Data)

هدوپ (Hadoop)

Apache Hadoop مجموعه ای از برنامه های نرم افزاری اوپن سورس است که استفاده از شبکه تعدادی رایانه را برای حل مشکلات مربوط به حجم کلان داده و محاسبات تسهیل می کند. این فریمورک نرم افزاری برای ذخیره سازی توزیع شده و پردازش کلان داده را با استفاده از مدل برنامه نویسی MapReduce فراهم می کند. در اصل برای رایانش خوشهای ساخته شده از سخت افزار Commodity computing که هنوز هم استفاده از آن متداول است، در دسته های سخت افزاری سطح بالا نیز استفاده شده است. کلیه ماژول های موجود در Hadoop با این فرض اساسی طراحی شده اند که خرابی های سخت افزاری اتفاق رایج است و باید بطور خودکار توسط فریمورک کنترل شود.

آپاچی کسندرا (Cassandra)

Apache Cassandra یک پایگاه داده توزیع شده با مقیاس پذیری و با کارایی بالا است که برای مدیریت مقادیر زیادی از داده ها در بین تعداد زیادی از سرورهای کالا طراحی شده است و دسترسی بالا بدون هیچ نقطه شکستی را فراهم می کند. همچنین یک نوع پایگاه داده NoSQL است. Apache Cassandra اوپن سورس، توزیع شده و سیستم ذخیره سازی غیر متمرکز / توزیع شده (پایگاه داده)، برای مدیریت حجم زیادی از داده های ساخت یافته است که در سراسر جهان گسترش یافته است.

Apache Hive

Apache Hive پلتفرمی است که برای استفاده از اسکریپت های SQL برای انجام عملیات MapReduce استفاده می شود. Hive یک ابزار زیرساخت انبار داده برای پردازش داده های ساخت یافته در Hadoop است که در بالای Hadoop قرار می گیرد تا اطلاعات Big Data را خلاصه کند و آنالیز و querying را آسان انجام دهد.

در ابتدا، Hive توسط فیس بوک توسعه یافت. بعدها بنیاد نرم افزار آپاچی آن را گسترش داد و آن را به عنوان منبع باز تحت نام Apache Hive توسعه داد. Hive توسط شرکت های مختلف استفاده می شود. به عنوان مثال، آمازون از آن در Amazon Elastic MapReduce استفاده می کند. Hive یک پایگاه داده رابطه ای، طراحی برای (OLTP) و یک زبان برای پرس و جو در real-time و بروز رسانی سطح سطر نیست.

مانگو دی بی (MongoDB)

MongoDB یک پایگاه داده سند گرا، چند سکویی، مقیاس پذیر و انعطاف پذیر است که نیازهای فهرست بندی و ایجاد کوئری را بر آورده می کند. داده ها را در اسناد انعطاف پذیر مانند جی سون ذخیره می کند، به این معنی که فیلدها می توانند از در هر سند متفاوت باشند و ساختار داده ها را می توان در طول زمان تغییر داد. MongoDB از اسناد JSON مانند اسکریپت به عنوان یک برنامه پایگاه داده NoSQL استفاده می کند. مدل سند گرا در کد برنامه برای اشیا نقشه ایجاد می کند که کار را برای داده ها آسان تر می کند. نمایش آگهی های ویژه، فهرست بندی و جمع آوری Realtime راه های قدرتمند برای دسترسی و تجزیه و تحلیل داده های شما را فراهم می کند.

آپاچی اسپارک (Apache Spark)

آپاچی اسپارک یک فریمورک محاسبات توزیع شده همه منظوره اوپن سورس است. اسپارک واسط برای برنامه نویسی کل توزیع ها با موازی سازی داده ها و تلرانس را فراهم می کند. ابتدا در دانشگاه کالیفرنیا، AMPLab برکلی توسعه یافته، بانک کد Spark بعداً به بنیاد نرم افزار آپاچی اهدا شد، که از آن زمان تاکنون نیز ادامه دارد. در ابتدا Spark به ما یک فریمورک جامع و یکپارچه برای مدیریت نیازهای پردازش کلان داده با مجموعه های متنوع و مختلف داده (داده های متنی، نمودار داده ها و غیره) و نیز منبع داده را ارائه می دهد. Spark این امکان را فراهم می کند تا سریعا برنامه های کاربردی را در جاوا، اسکالا یا پایتون بنویسید. این فریمورک دارای بیش از 80 اپراتور سطح بالا است. شما می توانید آن را به صورت تعاملی برای پرس و جوی داده های درون پوسته استفاده کنید. علاوه بر نقشه و کاهش عملیات، از کوئری های اس کیو ال، جریان داده ها، یادگیری ماشینی و پردازش داده های گرافیکی پشتیبانی می کند.

اوراکل (Oracle)

غول بانک اطلاعاتی دارای مجموعه کاملی از محصولات Big Data Integration، مانند Data Cloud Platform Cloud است که از جریان داده در real-time، پردازش داده های دسته ای، کیفیت داده های شرکت و قابلیت های مدیریت داده ، Stream Analytics، پشتیبانی از IOT و پشتیبانی آپاچی کافکا از طریق سرویس ابر Cloud Event Hub را پشتیبانی می کند.